🗞️ Het belangrijkste nieuws

Cybersecurity-AI toont zijn kracht – aan beide zijden

Je hoeft niet ver te zoeken naar bewijs dat AI het beveiligingslandschap fundamenteel verandert. Vorige maand beperkte Anthropic zelf de toegang tot Claude Mythos, omdat het model té effectief bleek in beveiligingsonderzoek. Inmiddels worden de implicaties duidelijk. Aan beide kanten van het schaakbord.

Firefox als use case

Mozilla, de maker van onder meer Firefox, liet in april 2026 zien wat AI-gestuurde beveiligingsanalyse kan opleveren. Anthropics Mythos Preview en andere AI-modellen hielpen het Firefox-team om in april 2026 maar liefst 423 bugs te fixen. Een jaar eerder waren dat er 31.

Onder de gevonden bugs zaten kwetsbaarheden in de sandbox – de afgeschermde omgeving die de browser isoleert van de rest van je systeem – en een fout in de verwerking van een HTML-element die al vijftien jaar onopgemerkt in de code zat.

Dit is precies waar AI ineens nuttig blijkt: grote, oude codebases doorzoeken en aanvalspaden vinden die voor menselijke onderzoekers onevenredig veel tijd kosten.

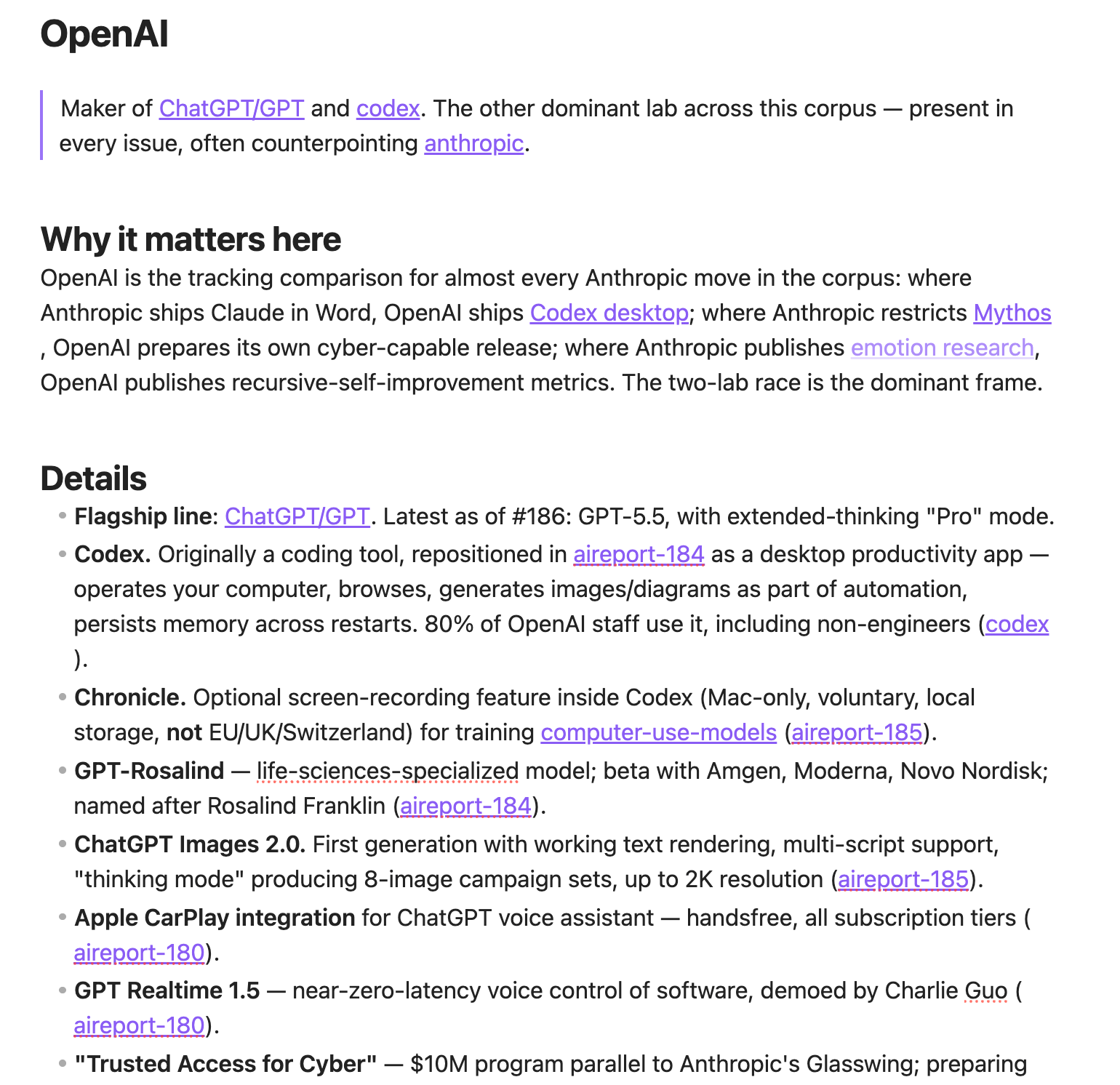

OpenAI beweegt hierin mee. Het bedrijf rolt OpenAI GPT-5.5-Cyber (interne naam Spud) beperkt uit naar goedgekeurde teams die kritieke infrastructuur beschermen. Via het Trusted Access for Cyber-programma krijgen die teams toegang tot een krachtigere versie van het model dan gewone gebruikers, voor taken als malware-analyse, reverse-engineering en het testen van de beveiligingshouding, de mate van paraatheid en aanpak van een organisatie tegen cyberdreigingen.

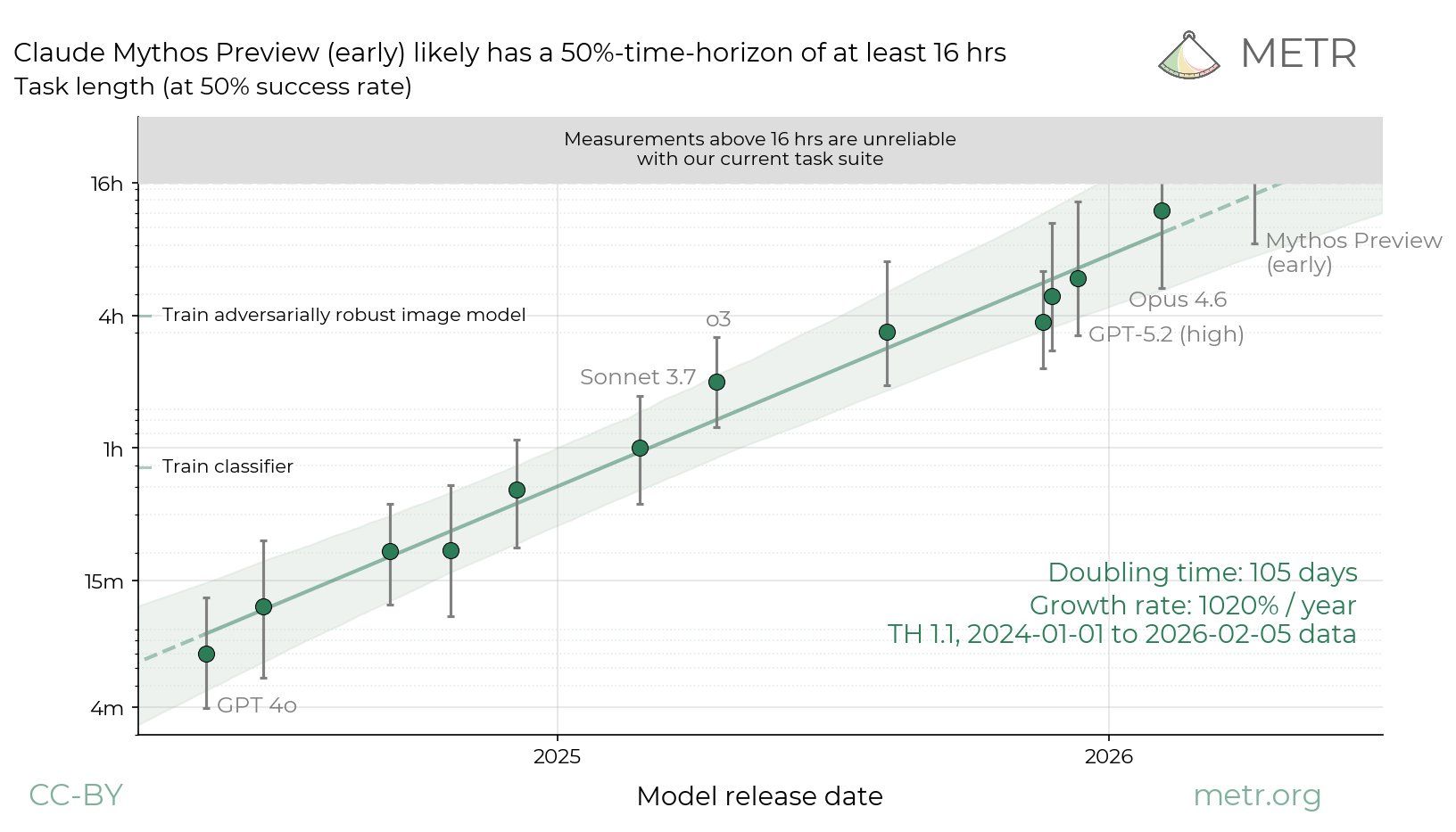

Een meetlat voor langer autonoom werken

METR, de non-profitorganisatie die frontiermodellen test op autonome taken, voegde Mythos recent toe aan zijn zogenoemde time-horizon-dashboard. Dat meet hoeveel tijd een menselijke expert nodig zou hebben voor taken die een AI-agent in ongeveer de helft van de gevallen succesvol afrondt. Mythos komt uit op zo'n 17 uur.

Dat getal is relevant voor cybersecurity, omdat aanvallen zelden bestaan uit één losse opdracht. Een kwetsbaarheid vinden, een exploit bouwen, logging omzeilen en een patch beoordelen zijn ketens van kleinere beslissingen. Mythos kan die keten steeds langer zelfstandig doorlopen.

Kanttekeningen

Meer autonomie vraagt om meer voorzichtigheid, en die zien we. Mozilla laat AI niet zelfstandig patches schrijven en uitrollen. De modellen helpen bij het vinden van kwetsbaarheden en schetsen soms een oplossing, maar een engineer schrijft de uiteindelijke fix en een andere engineer controleert die.

Ook politiek groeit de aandacht. Het Witte Huis overweegt na Mythos opnieuw toezicht op de krachtigste modellen, en Anthropic heeft te kennen gegeven de toegang niet verder te willen uitbreiden. Dat is nog geen vastgesteld beleid, maar het laat zien hoe snel technische modelcapaciteit politieke aandacht trekt. Want die krachtige capaciteit van de frontiermodellen blijft niet beperkt tot de verdedigende kant.

Oplichting op autopilot

AI maakt identiteitsfraude en digitale oplichting schaalbaarder. Experian, een toonaangevend cybersecuritybedrijf, meldt dat 40 procent van de 5000 datalekken die het in 2025 behandelde door AI werd aangestuurd. Het bedrijf voorspelt bovendien dat zelfstandig handelende AI dit jaar de belangrijkste oorzaak van datalekken zal vormen.

Enige nuance: die 40 procent geldt voor de datalekken die Experian zelf behandelde, niet voor alle mondiale incidenten. Maar de onderliggende trend is herkenbaar voor iedereen in de sector: AI maakt phishing persoonlijker, synthetische identiteiten overtuigender en verkenningswerk sneller. Vroeger moest een aanvaller scripts schrijven, mensen inhuren of eindeloos handmatig zoeken. Nu volstaat een agent die darkwebfora scant, persoonsgegevens combineert en op schaal varianten uitprobeert.

Wat betekent dit voor jou?

De kloof tussen wat beveiligingsteams kunnen en aanvallers kunnen, wordt niet groter, maar juist kleiner. AI versnelt beide kanten van het schaakbord. De teams die dat inzien en de juiste samenwerking tussen mens en machine inrichten, staan straks een stuk sterker.

Google stopt stilletjes AI in je browser

Je opent Google Chrome om even iets op te zoeken en ontdekt achteraf dat je browser stilletjes een AI-model van 4 gigabyte heeft binnengehaald. Dit is precies wat een aantal Chrome-gebruikers deze week overkwam. En het leidde tot vragen over controle, privacy en hoe diep Google AI in je dagelijkse workflow verankert.

Wat is er aan de hand?

De ophef draaide om Gemini Nano, Googles taalmodel dat lokaal op je apparaat kan draaien. Gebruikers troffen in een map van hun browser een bestand van 4 GB aan, genaamd weights.bin. Privacyonderzoeker Alexander Hanff klaagde dat Chrome dit zonder duidelijke melding of expliciete toestemming had binnengehaald.

Chrome kan Gemini Nano op de achtergrond downloaden voor zogeheten built-in AI-API's. Dat zijn browserfuncties die direct op je apparaat werken, en waarmee websites of Chrome zelf lokale AI-taken kunnen uitvoeren, zoals het samenvatten, herschrijven of proeflezen van teksten of andere kleine taalmodeltaken.

Volgens Google downloadt Chrome dit pas als een website of functie zo'n lokale AI-API daadwerkelijk aanroept, en alleen als je hardware dat ondersteunt. Maar voor veel gebruikers voelde het alsof Google die keuze al voor hen had gemaakt.

En dan is er nog de klassieke Google Search

Tegelijk kondigde Google vijf aanpassingen aan die AI Overviews en AI Mode meer zichtbare links naar externe websites moeten geven. Denk daarbij aan extra inline links, bronvermeldingen, hover-previews en labels voor nieuws waarop je al geabonneerd bent.

Dat klinkt als een technische update, maar is vooral een gebaar naar uitgevers. Die zien dat gebruikers minder vaak doorklikken naar hun websites.

Ars Technica noemt het een koerscorrectie. Google zegt zelf dat AI Overviews het webverkeer niet wezenlijk onder druk zetten. Uitgevers, SEO-analisten en rechtszaken schetsen een minder rooskleurig beeld.

Kanttekeningen

Een van de scherpste claims komt van Penske Media, het bedrijf achter onder meer Rolling Stone en Variety: zoekopdrachten met AI Overviews zouden het aantal kliks naar websites tot maar liefst 90 procent kunnen verminderen. Hoewel het een veelgehoorde klacht is onder uitgevers, komen deze cijfers van één partij met een direct belang in de uitkomst.

In Europa kan het extra spannend worden: daar geldt de digitalemarktenverordening, waarmee toezichthouders Google mogelijk kunnen dwingen uitgevers meer keuze te geven om niet in AI-antwoorden te verschijnen. Of dat tot afdwingbare maatregelen leidt, is nog onzeker.

Waarom is dit belangrijk?

De AI-strijd gaat allang niet meer over welk model het slimst is. Eerder om wie de laag beheerst waarop je werkt. Google verankert AI in zowel je browser als je zoekmachine en maakt het daarmee onderdeel van de standaardroute naar informatie. Voor jou als gebruiker betekent dat gemak. Maar ook minder zicht op wat lokaal gebeurt, wat naar de cloud gaat en welke websites nog verkeer krijgen. De infrastructuur wordt onzichtbaarder. Je afhankelijkheid van Google groeit.

⚡ AI Pulse

ChatGPT krijgt een vertrouwd contact voor ernstige veiligheidszorgen. OpenAI introduceert Trusted Contact voor volwassen ChatGPT-gebruikers. Je kunt vrijwillig iemand aanwijzen die een melding krijgt als geautomatiseerde systemen én getrainde reviewers denken dat een gesprek kan wijzen op een ernstig risico op zelfbeschadiging of suïcide. Volgens de Help Center-pagina wordt geen gespreksinhoud gedeeld en krijgt de contactpersoon alleen een melding. De functie is alleen beschikbaar voor persoonlijke accounts en is nadrukkelijk geen vervanging voor professionele hulp- of crisisdiensten.

OpenAI maakt spraak-AI slimmer. OpenAI heeft nieuwe realtime-audiomodellen geïntroduceerd in de API. GPT Realtime Translate kan live vertalen in ruim 70 talen. In een demo is te horen dat het model niet van slag raakt bij onverwachte taalwisselingen of technische terminologie. GPT Realtime 2 is bedoeld voor voice agents die tijdens een gesprek kunnen redeneren, tools kunnen aanroepen en de gebruiker tussendoor op de hoogte houden. In een demo checkt de assistant een agenda, wacht netjes op de spreker en werkt daarna zijn CRM-notities bij. Voor bedrijven die hun klantcontact of interne processen willen automatiseren, verlaagt dit de drempel aanzienlijk.

Apple geeft iOS mogelijk een AI-keuzemenu. Volgens Bloomberg werkt Apple voor iOS 27 aan een nieuwe functie die ‘Extensions’ zou gaan heten. Daarmee zouden gebruikers AI-modellen van geïnstalleerde apps kunnen kiezen binnen Apple Intelligence-functies zoals Siri, Schrijfhulp en Image Playground. De modellen van Google en Anthropic worden momenteel getest, maar over de toekomst van ChatGPT, momenteel het enige beschikbare model in iOS, bestaat nog onduidelijkheid. Strategisch past het perfect bij Apple: het gaat er niet om de beste AI te bouwen, maar om de beste omgeving te bieden om AI te gebruiken.

Claude kruipt nu echt Office in. Claude for Microsoft 365 is nu algemeen beschikbaar en biedt integratie in Excel, PowerPoint en Word voor alle betaalde Claude-abonnementen. Hierbij draait het niet alleen om het gebruik van Claude binnen je Office-programma’s, maar ook om contextuele samenhang: begin in Outlook, werk verder in Word, bouw een model in Excel en maak daarna een presentatie in PowerPoint, zonder het gesprek telkens opnieuw te hoeven toelichten. Claude kan onder meer formules opstellen, slides maken in je template, wijzigingen in Word voorstellen als tracked changes en Outlook-mails voorbereiden, klaar om te versturen.

Gesponsord

Zijn jouw AI-fundamenten geschikt voor het doel?

De meest AI‑fitte organisaties beschikken over een sterke basis: vaardigheden van medewerkers, technologie en data, governance en risicomanagement. Met deze sterke fundamenten levert AI twee keer zoveel waarde op.

🛠️ AI Toolkit

Bouw een AI-tweede brein dat met je meegroeit (deel 1)

Je notitie-app krijgt een hardwerkende bibliothecaris

Stel je voor dat je notitie-app een eigen bibliothecaris in dienst neemt. Hij leest alles wat je toevoegt, maakt netjes samenvattingen, legt verbanden tussen wat je gisteren opschreef en wat je vorig jaar bewaarde, en als je iets wilt weten hoeft hij niet te zoeken. Hij weet het al.

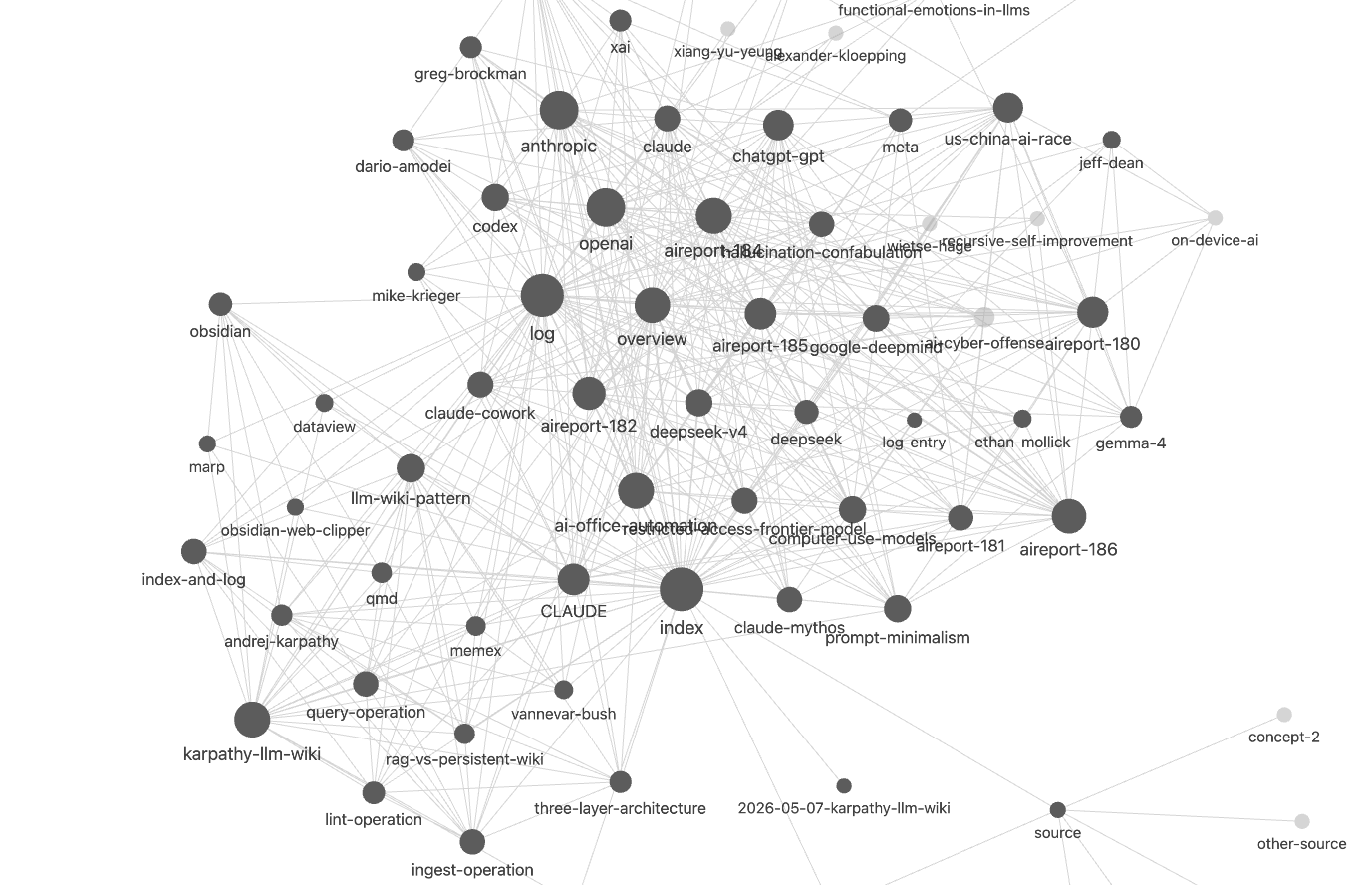

Dat klinkt als sciencefiction, maar het werkt. Onze Xiang testte het de afgelopen weken uit door een levende kennisbibliotheek te bouwen van alle AI Report-edities tot nu toe – een complete AI Report-wiki die ze nu kan raadplegen. Als ze aan de bibliothecaris vraagt wanneer we voor het eerst over Claude Cowork schreven, krijgt ze direct het antwoord, met de juiste editie als bron. Klikken op ‘OpenAI’ levert een rijke encyclopediepagina op met alles wat AI Report ooit over het bedrijf publiceerde, inclusief verwijzingen tussen edities.

Het is een van die zeldzame momenten waarop je écht denkt: dit verandert iets fundamenteels aan hoe ik werk.

Waar dit vandaan komt

Begin april deelde Andrej Karpathy, mede-oprichter van OpenAI en voormalig AI-baas bij Tesla (én de man die de term vibecoding bedacht, ofwel chatten met AI in plaats van zelf programmeren) een opmerkelijke post op X. Geen tool, geen app: een werkmethode. Hij beschreef hoe hij AI gebruikt om persoonlijke kennisbibliotheken te bouwen die met hem meegroeien.

Het werd binnen dagen miljoenen keren bekeken en duizenden keren overgenomen, want deze methode lost een frustratie op die iedereen die met AI werkt herkent: je vertelt ChatGPT of Claude over een project, krijgt nuttige hulp, sluit het tabblad, en de volgende dag ben je alles kwijt. Begin maar weer opnieuw.

Karpathy's idee draait dat om. In plaats van dat de AI elke keer opnieuw door je documenten moet bladeren, laat je de AI één keer alles lezen en samenvatten in een groeiend, onderling gelinkt notitiesysteem. Bij elke nieuwe bron werkt de AI dat systeem bij. Hij doet het saaie werk, jij blijft de denker.

Karpathy beschrijft de methode op hoofdlijnen, maar laat de keuze van programma's open. Wij hebben het de afgelopen weken uitgebreid getest met verschillende combinaties, en de set-up die we je vandaag leren werkte voor ons het beste – én is verrassend toegankelijk, ook zonder enige technische achtergrond.

Wat leer je in deze serie?

dit is een driedelige tutorial. Vandaag deel 1: de fundering. Aan het einde van deze tutorial heb je:

Obsidian geïnstalleerd, een gratis notitie-app waarin je kennisbibliotheek straks gaat leven.

Claude Code werkend op je computer, de slimme bibliothecaris die alles voor je gaat bijhouden.

Beide programma's verbonden, zodat ze rechtstreeks kunnen samenwerken.

Inzicht in hoe je oude notities (bijvoorbeeld uit Apple Notes) eenvoudig kunt importeren.

Een eerste testopdracht uitgevoerd zodat je weet dat alles werkt.

De bouwstenen klaarstaan voor deel 2, waarin je voor je ogen een hele kennisbibliotheek ziet ontstaan.

In deel 2 maken we er daadwerkelijk een levende kennisbibliotheek van. In deel 3 laten we vijf à zes concrete manieren zien waarop je hem in je werk en leven kunt inzetten – van editorial brain en research-assistent tot persoonlijk archief.

Waarom je dit wilt

Drie pijnpunten die deze methode oplost:

Je gebruikt AI voor onderzoek of een lopend project, maar elke nieuwe sessie begint vanaf nul. Je legt steeds opnieuw context uit. Met deze methode bouwt je AI permanent geheugen op over jouw werk.

Je notities staan verspreid over Notion, Apple Notes, je mailbox, Google Docs en die ene klembord-app op je telefoon. Je weet dat je ergens iets hebt opgeschreven, maar niet meer waar. Met deze methode komt alles in één doorzoekbare bibliotheek.

Je leest veel artikelen, papers of rapporten, maar het blijft losse kennis. Met deze methode legt je AI automatisch verbanden tussen alles wat je toevoegt.

Abonneer je om verder te lezen

Welke AI-tool gebruik je waarvoor? We testen ze zodat jij dat niet hoeft te doen. Eerlijke vergelijkingen, geen sponsored content.

Abonneer nuDit zit achter de betaalmuur:

- Onafhankelijke tool-reviews en vergelijkingen

- Concrete aanbevelingen: welke tool past bij welk werk

- Bespaart je uren uitzoekwerk

- Regelmatig bijgewerkt met nieuwe tools