🗞️ Het belangrijkste nieuws

Anthropic lekt per ongeluk informatie over krachtigste en gevaarlijkste AI-model ooit

Door een foutje in het websitesysteem stonden bijna 3000 ongepubliceerde bestanden van Anthropic (het bedrijf achter AI-assistent Claude) op het openbare internet. Daartussen: een blogpost over een model dat nog niemand had mogen zien. Wat erin stond, is alarmerend én fascinerend.

Bron afbeelding: Anthropic

Wat is er gelekt?

In de ongepubliceerde blogpost beschrijft Anthropic een nieuw AI-model genaamd Claude Mythos, ook aangeduid als 'Capybara'. Het is een geheel nieuwe klasse, krachtiger dan het huidige topmodel Opus. Een woordvoerder van Anthropic bevestigde tegenover Fortune dat het model bestaat, momenteel wordt getest door een groepje klanten, en noemde het: “Het meest capabele model dat we ooit hebben gebouwd.”

Maar het is niet alleen de kracht die opvalt. Anthropic waarschuwt er in de gelekte post expliciet voor dat Mythos ongekende risico's op het gebied van cyberveiligheid met zich meebrengt. Volgens het bedrijf ligt het model momenteel ver voor op alle andere AI-modellen qua cybercapaciteit. Daarnaast vreest Anthropic dat het een nieuwe generatie modellen kan introduceren die kwetsbaarheden kunnen misbruiken op een manier die de capaciteiten van verdedigers ver voorbijstreven. Precies daarom kiest Anthropic voor een voorzichtige, gefaseerde uitrol: eerst alleen organisaties die het model kunnen inzetten om hun eigen digitale verdediging te versterken.

De ironie is niet te missen: het AI-lab dat bekendstaat als het meest voorzichtige ter wereld, lekt zijn gevaarlijkste model via een simpele configuratiefout in zijn eigen websitebeheer. Dat zegt iets over hoe snel deze technologie zich ontwikkelt, en hoe moeilijk het is om alles onder controle te houden, zelfs voor de partij die daar het meest mee bezig is.

Het Pentagon wil Claude terug

Achter de schermen speelt Mythos' cyberveiligheidskracht ook een rol in het lopende conflict tussen Anthropic en het Amerikaanse ministerie van Defensie. Volgens Axios waarschuwt Anthropic in vertrouwelijke gesprekken met overheidsambtenaren dat de volgende generatie modellen zowel offensieve als defensieve cybercapaciteiten fors zal versterken. Militaire insiders vertelden Axios dat Anthropics AI veel beter is voor oorlogsvoering dan elke andere AI op de markt, en dat concurrenten er maanden over zouden doen om in de buurt te komen.

Dat vergroot de druk om de impasse te doorbreken voor de deadline van zes maanden die de Amerikaanse overheid eerder stelde. Een federale rechter oordeelde deze week al in het voordeel van Anthropic: de aanmerking als 'risico voor de nationale veiligheidsketen' werd geschorst. De rechter concludeerde dat de maatregelen bedoeld lijken om Anthropic te straffen in plaats van de nationale veiligheid te dienen.

Een hardnekkige roddel in Washington beschrijft hoe er toch een deal zou kunnen komen. Brad Gerstner, investeerder in Anthropic en adviseur van CEO Dario Amodei, is ook de architect van de zogeheten Trump Accounts, een spaarregeling die iedere pasgeborene in de VS duizend dollar geeft. Volgens Axios zou Anthropic kunnen aanbieden om bij te dragen aan die regeling, als een soort vroegtijdige stap richting het delen van AI-welvaart met de samenleving. Dat zou dan een ongewone combinatie zijn van een techbedrijf dat betrokken is bij sociaal beleid, maar in het huidige politieke klimaat misschien precies wat nodig is om beide kanten aan tafel te krijgen.

OpenAI offert alles op voor 'Spud'

Anthropic is niet het enige lab dat alles op alles zet. Bij OpenAI (het bedrijf achter ChatGPT) is de training afgerond van een nieuw model met de codenaam Spud. Sam Altman vertelde medewerkers dat Spud de economie kan versnellen. De release wordt binnen enkele weken verwacht.

Hoe radicaal de focus verschuift, schreven we vorige week al: Sora is stopgezet, de Disney-deal is van tafel en alle side quests - zoals erotische chatbots - zijn geschrapt. Maar het gaat verder. Altman heeft het directe toezicht op de veiligheids- en beveiligingsteams overgedragen aan andere bestuurders, zodat hij zich volledig kan richten op het binnenhalen van kapitaal en rekenkracht. Zijn productorganisatie is hernoemd tot AGI Deployment, het eerste teken dat OpenAI het bereiken van AI op menselijk niveau niet meer als verre toekomst beschouwt, maar als een concreet project.

Een patroon dat je niet kunt negeren

Twee labs die tegelijk alles opzij schuiven voor hun volgende model. Dat is geen toeval. Het wijst erop dat we op de drempel staan van een nieuwe stap in wat AI kan. Of die stap zo groot wordt als de labs suggereren, moet nog blijken. Maar als OpenAI bereid is een miljardendeal met Disney te laten schieten, en Anthropic openlijk waarschuwt voor de cyberveiligheidsrisico's van zijn eigen creatie, zegt dat genoeg over wat zij denken dat eraan komt.

Voor jou als gebruiker betekent het concreet dat ChatGPT en Claude merkbaar anders worden dan ze nu zijn.

De nieuwste IQ-test voor AI: mensen scoren 100 procent, de beste AI haalt niet eens 1 procent

En dan even een stukje broodnodige relativering. Want terwijl AI-labs om het hardst roepen dat hun volgende model alles gaat veranderen, verscheen deze week een nieuwe test die laat zien hoe ver we nog verwijderd zijn van AI die écht zo slim is als een mens.

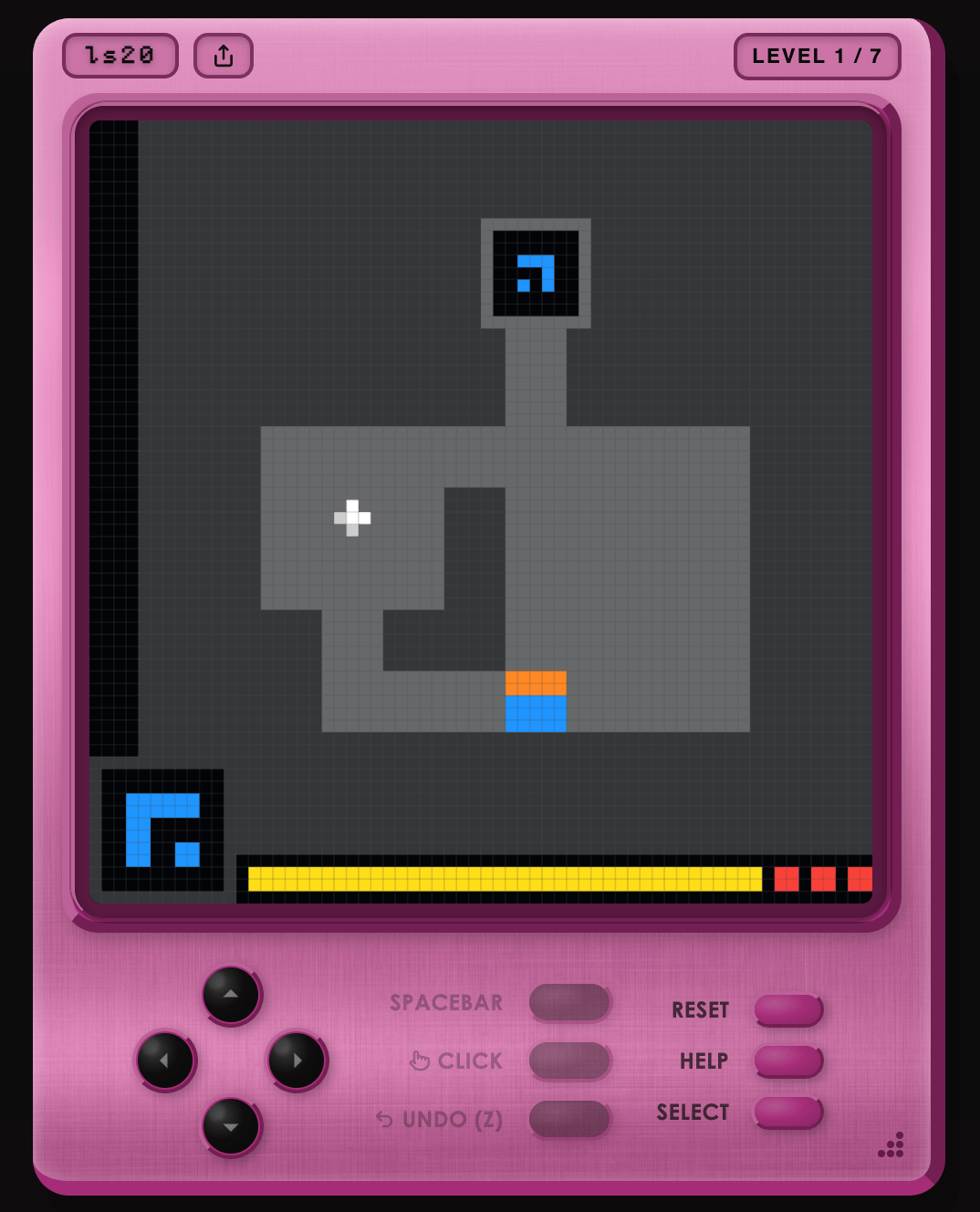

Wat is ARC-AGI-3?

ARC-AGI is een soort intelligentietest voor AI-systemen, bedacht door François Chollet, een gerespecteerd AI-onderzoeker die ook bij Google werkte. De test wordt door experts gezien als een van de belangrijkste meetlatten voor AGI (AI die breed op menselijk niveau presteert). We schreven eerder over eerdere versies: op ARC-AGI-1 en -2 scoorden de nieuwste AI-modellen inmiddels op menselijk niveau of hoger. Maar deze week verscheen versie 3, en de resultaten zijn ontnuchterend.

De test werkt als een soort puzzelspel. Je wordt in een onbekende omgeving gedropt zonder uitleg, zonder regels, zonder doel. Je moet zelf uitzoeken wat er aan de hand is, wat je moet bereiken en hoe. Denk aan een computerspelletje waar je geen handleiding bij krijgt: je klikt rond, ontdekt dat een plusje een vorm draait, leert dat je het blokje links onder moet laten lijken op het voorbeeld rechtsboven, en past die kennis toe in steeds moeilijkere levels.

Mensen lossen 100 procent van de opgaven op bij de eerste poging, zonder enige voorbereiding. De beste AI-modellen van OpenAI, Google en Anthropic daarentegen kwamen niet boven de 1 procent uit.

Waarom scoren AI-modellen zo slecht?

De vorige versies van de test werden 'gekraakt' door een combinatie van twee dingen. Ten eerste: de nieuwe redeneerfunctie die sinds 2024 in AI-modellen zit, waarmee ze stap voor stap kunnen nadenken in plaats van direct een antwoord te geven. Ten tweede, en dat is pikanter: de publieke en de geheime testsets leken te veel op elkaar. AI-labs konden hun modellen trainen op duizenden variaties van vergelijkbare opgaven, waardoor ze de test in feite konden gamen zonder echt te begrijpen wat ze deden.

ARC-AGI-3 pakt dat nu aan. De publieke oefenopgaven zijn bewust heel anders dan de geheime testopgaven. Je kunt niet meer spieken door op grote schaal vergelijkbare puzzels te oefenen. Bovendien mogen AI-modellen geen speciaal voor de test gebouwde hulpsystemen gebruiken. Ze krijgen alleen de instructie: “Je speelt een spel. Doel is om te winnen.”

Moving goalposts?

De kritiek is voorspelbaar: verschuiven de makers niet gewoon steeds de lat? Chollet is daar eerlijk over. Hij heeft gezegd dat hij net zo lang doorgaat tot het verschil is opgeheven en redeneert: als er een zogenaamde algemene intelligentie is, dan zou die dit soort taken ook makkelijk moeten kunnen doen. Zolang er een kloof bestaat tussen hoe efficiënt mensen en machines leren, hebben we geen AGI.

Er is ook terechte kritiek op de strenge beoordeling. De test beoordeelt niet alleen óf je de puzzel oplost, maar ook hoe efficiënt je dat doet vergeleken met mensen. Neem je tien keer zoveel stappen als een mens, dan wordt die inefficiëntie kwadratisch bestraft: je scoort niet 10 procent, maar 1 procent. Zelfs de op-een-na-beste menselijke speler zou met die berekening maar rond de 50 procent scoren.

Waarom dit ertoe doet

ARC-AGI-3 is misschien wel de creatiefste en eerlijkste test die ooit voor AI is gemaakt. Hij meet niet of een model feiten kan opdreunen of code kan schrijven, maar of het echt kan leren, verkennen en zich aanpassen aan iets volkomen nieuws. En dat is precies de vaardigheid die nodig is voor de autonome AI-onderzoekers en AI-agents die de AI-labs ons beloven.

De boodschap: AI is indrukwekkend goed geworden in taken waar het op is getraind. Maar gooi een AI in het diepe bij iets compleet nieuws, en hij zinkt als een baksteen. Dat is goed om in het achterhoofd te houden wanneer de volgende golf aan 'revolutionaire' aankondigingen langskomt.

💻 AI Report zoekt versterking

AI Report groeit razendsnel en we zoeken een freelance redacteur die ons team komt versterken. Lijkt dit je wat? Neem dan hier een kijkje. Reageren kan tot 6 april.

We zijn ook op zoek naar een senior marketeer. We zijn de afgelopen anderhalf jaar hard gegroeid via organische kanalen. Nu willen we starten met marketing. Daarvoor zoeken we een freelance senior marketeer/growth lead. Iemand die niet alleen de marketingstrategie uitdenkt, maar die ook zelf bouwt, test en uitvoert. Lees meer over de vacature hier. Reageren kan tot 15 april.

Gesponsord

Vind je mogelijkheden opnieuw uit in ons AI Lab

AI kan de wendbaarheid en waarde van jouw bedrijf vergroten. Nodig voor het stimuleren van bedrijfsgroei in het snel veranderende landschap van vandaag de dag. Vind jouw bedrijf opnieuw uit en creëer waarde met de AI-reis op maat in ons AI Lab.

🔮 Prompt whisperer

Bouw je eigen onderzoeksassistent met AI (deel 3 van 3)

Vandaag: een synthesemaker die alles samensmeedt tot heldere conclusies

De afgelopen weken bouwden we samen aan je onderzoeksassistent. In deel 1 maakten we een bronnenverwerker die snel overzicht creëert. In deel 2 voegden we de kritische lezer toe, die tegenstrijdigheden, verborgen aannames en methodologische zwaktes blootlegt. Je hebt nu een assistent die je bronnen kent, begrijpt hoe ze zich tot elkaar verhouden, en weet waar de zwakke plekken zitten.

Maar al die analyses leiden nog niet tot een conclusie. En dat is waar de meeste mensen vastlopen: je hebt bergen informatie verzameld, je weet wat sterk is en wat zwak, maar hoe vertaal je dat naar een helder antwoord op je onderzoeksvraag?

Vandaag voegen we het sluitstuk toe: de synthesemaker. Vaardigheden om alles samen te brengen in conclusies die je kunt verdedigen, inclusief eerlijke erkenning van wat je nog niet weet.

Wat leer je vandaag?

Hoe je je onderzoeksassistent afrondt met synthesevaardigheden.

Testen op ‘wat weten je nu weet’: conclusies trekken zonder overdreven claims.

Een managementsamenvatting maken die in twee minuten te lezen is.

De open vragen en kennishiaten helder formuleren.

Je complete analyse visualiseren in één overzichtsdiagram.

Pro-tips om je synthesemaker optimaal te benutten.

Abonneer je om verder te lezen

Het verschil tussen een oké en een briljant AI-antwoord zit in de prompt. Word nog beter in prompten en laat AI écht voor jou werken.

Dit zit achter de betaalmuur:

• Praktische prompt-tips die je meteen kunt gebruiken

• Uitleg waarom ze werken, zodat je zelf betere prompts leert schrijven

• Variaties per vakgebied

• Toegang tot het volledige archief